7/5~7 に富山国際会議場で開催された

DICOMO2023

で,須崎さんと熊澤さんが発表してきました.

また須崎さんは 最優秀プレゼンテーション賞とベストカンバーサント賞を受賞しました.

須崎

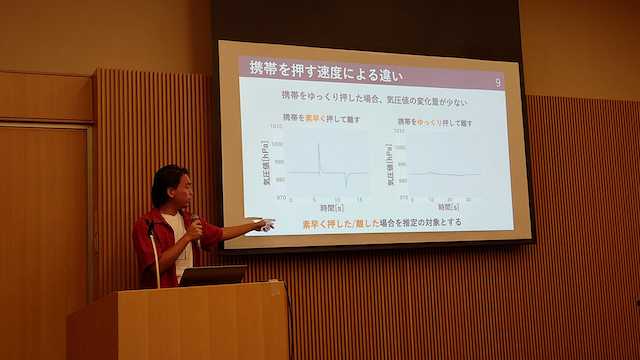

研究概要

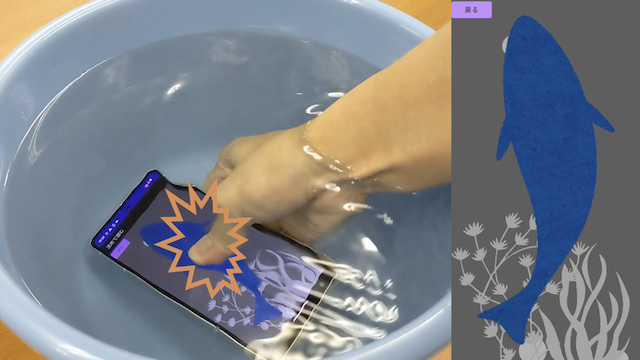

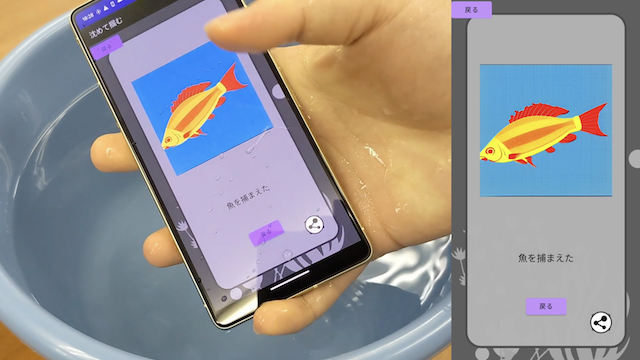

最近の携帯は防水性能が上がっていますが、我々には携帯を水に近づけてはいけないと言う考えがあります。 我々は携帯を水に沈めた時でも扱える入力インタフェースを提案します。 これにより、水中では扱えない画面を押す動作を水中でもできるようになります。 その応用例として、携帯を水に沈めて遊ぶ魚の掴み取りアプリを作成しました。

感想

多くの発表と参加者の中で、2つの賞を受賞でき大変光栄に思います。 大学院に進学して得た多くの学びを生かせたと思います。

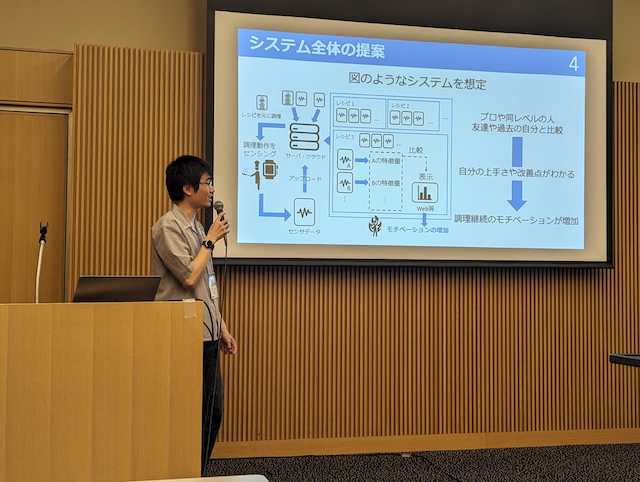

熊澤

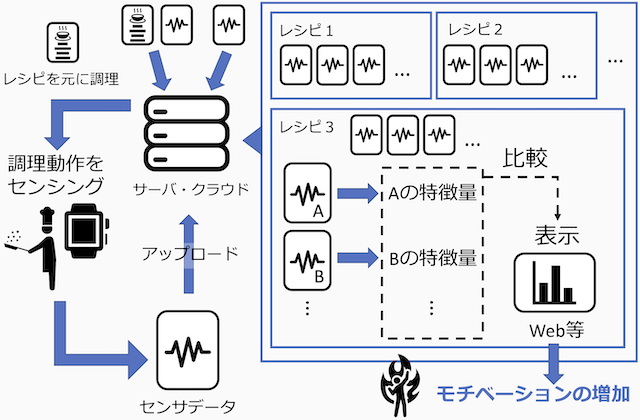

研究概要

料理のレシピを共有する方法にはさまざまな種類があり世の中に浸透している.またレシピを利用して作成したものを報告する機能がある.しかし過去の自分や他者と調理能力や効率について比較できる仕組みがない状態である.そこで本研究ではレシピと調理動作を共有・比較し調理に対する楽しさの増加を目的とする.アプローチとしてウェアラブルセンサを使い調理作業のセンシングを行い比較するための特徴量を抽出する.研究の全体像を4つの項目「調理動作のセンシング」「調理能力と効率の分析」「分析結果の共有」「履歴や他者との比較を可視化」に分けてられる.調理動作の分析・比較を「各場所での分析と比較」と「場所移動の分析と比較」に分けて説明している.各場所での分析と比較では切る工程を例にして実際にどのような結果が得られるのかを調べた.場所移動の分析と比較ではハンバーグ調理の工程を例にして実際にどのような特徴が見られるのかを調べた.

感想

初めて県外での発表で緊張しましたが,今までの発表経験により今まで以上の発表になりました.